كيفية تثبيت أحدث نماذج اللغة الكبيرة (LLMs) محليًا على جهاز Mac

في السنوات الأخيرة، أصبحت نماذج اللغة الكبيرة (LLMs) شائعة بشكل متزايد لقدرتها على إنشاء نصوص شبيهة بالنصوص البشرية والمساعدة في مهام مختلفة. ليست كل النماذج مفتوحة المصدر، ولكن كل شركة تقنية كبيرة تقريبًا لديها إصدار يسمح للمستخدمين بتنزيله وتشغيله.

يمكن أن يكون تشغيل هذه النماذج محليًا على جهاز Mac الخاص بك مفيدًا لأسباب تتعلق بالخصوصية والتكلفة. في هذه المقالة، سنستكشف كيفية تثبيت وتشغيل LLMs باستخدام Ollama، وهي أداة قوية للمطورين والمستخدمين المبتدئين، وسنناقش بعض أدوات واجهة المستخدم الرسومية التي يمكن أن تبسط العملية لأولئك الذين يفضلون عدم استخدام Terminal نظام macOS.

بهذه الطريقة، يمكنك الوصول إلى أحدث نماذج النصوص المدعومة بالذكاء الاصطناعي من [Google] و[Microsoft] و[Meta] وشركات الذكاء الاصطناعي الأخرى مثل [Mistral] و[DeepSeek].

فهم LLMs: ماذا تعني المعلمات؟

قبل الغوص في عملية التثبيت، دعنا نوضح ما تعنيه أرقام مثل “7B” أو “14B” عند الإشارة إلى LLMs. تمثل هذه الأرقام حجم النموذج من حيث المعلمات (بالمليارات)، وهي في الأساس “المقابض والمفاتيح” التي يتم ضبطها بدقة أثناء التدريب.

يسمح العدد الأكبر من المعلمات للنموذج بالتقاط أنماط وعلاقات أكثر تعقيدًا في اللغة، مما قد يؤدي إلى أداء أفضل. ومع ذلك، من المهم ملاحظة أن المزيد من المعلمات لا يضمن دائمًا نتائج أفضل؛ تلعب جودة بيانات التدريب والموارد الحسابية المتاحة للنموذج أيضًا أدوارًا مهمة.

متطلبات النظام

ستحتاج إلى التأكد من أن جهاز [Mac] الخاص بك لديه المواصفات التالية على الأقل:

- macOS 10.15 أو أحدث (يوصى بنظام macOS 13 أو أعلى)

- ذاكرة وصول عشوائي (RAM) بسعة 8 جيجابايت على الأقل (يوصى بسعة 16 جيجابايت أو أعلى)

- مساحة تخزين مجانية تبلغ 10 جيجابايت (الحد الأدنى المطلوب لأصغر النماذج؛ النماذج الأكثر تقدمًا التي تحتوي على الحد الأقصى لعدد المعلمات تصل إلى حوالي 700 جيجابايت)

- معالج [Intel] متعدد النواة أو معالج [Apple Silicon] (يفضل M2 أو أعلى)

تثبيت Ollama

Ollama هي أداة مفتوحة المصدر تتيح لك تشغيل LLMs مباشرة على جهازك المحلي. إليك كيفية البدء:

- تنزيل Ollama: قم بزيارة موقع Ollama وقم بتنزيل إصدار macOS. يمكنك أيضًا استخدام [Homebrew] للتثبيت عن طريق تشغيل

brew install ollamaفي Terminal الخاص بك.

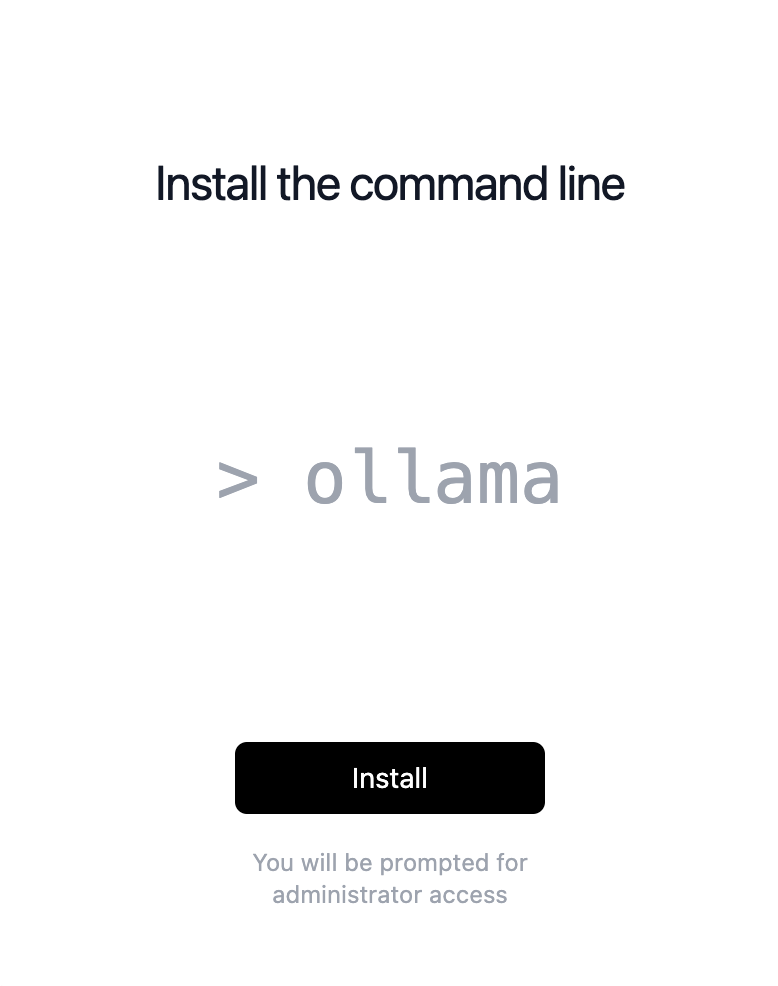

- تثبيت Ollama: إذا قمت بتنزيل المثبت، فانقر نقرًا مزدوجًا عليه، واتبع معالج الإعداد. إذا كنت تستخدم Homebrew، فانتقل إلى الخطوة 4.

- الخطوة التالية للمثبت هي ببساطة النقر فوق زر تثبيت، والذي سيطلب كلمة مرور المسؤول الخاصة بك.

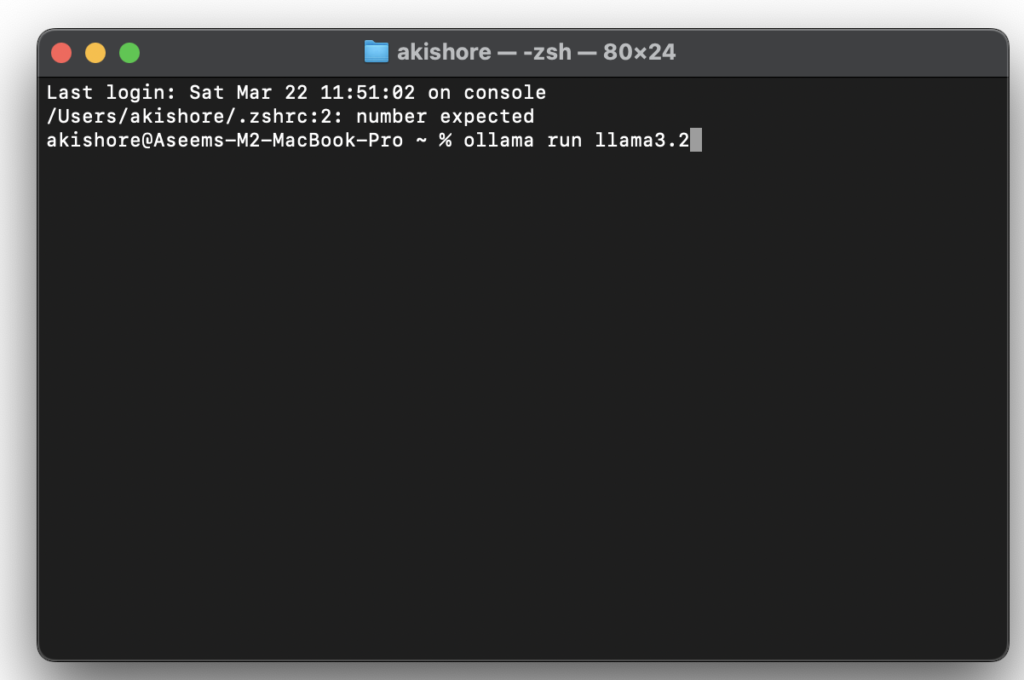

- تشغيل Ollama: افتح نافذة طرفية وابدأ Ollama كخدمة باستخدام الأمر

brew services start ollama. سيجعل هذا Ollama متاحًا على العنوانhttp://localhost:11434/. - تنزيل وتشغيل نموذج: استخدم الأمر

ollama pull <model-name>لتنزيل نموذج، ثم الأمرollama run <model-name>لتشغيله. على سبيل المثال، لتشغيل نموذج DeepSeek-R1، استخدم الأمرollama pull deepseek-r1متبوعًا بالأمرollama run deepseek-r1. - لتنزيل نسخة ذات معلمات أكبر من النموذج، ما عليك سوى إضافة نقطتين رأسيتين متبوعتين بالحجم. على سبيل المثال، لتنزيل نموذج 14B DeepSeek، ستستخدم الأمر ollama run deepseek-r1:14b. على موقع Ollama، يمكنك النقر فوق أي من النماذج وسيظهر لك جميع الأوامر المختلفة لكل إصدار.

يمكنك العثور على القائمة الكاملة لـ نماذج Ollama هنا. يمكنك أيضًا استخدام الأمر الثاني كما هو موضح أعلاه، وإذا لم يكن مثبتًا بالفعل، فسيقوم بسحب النموذج أولاً ثم تشغيله.

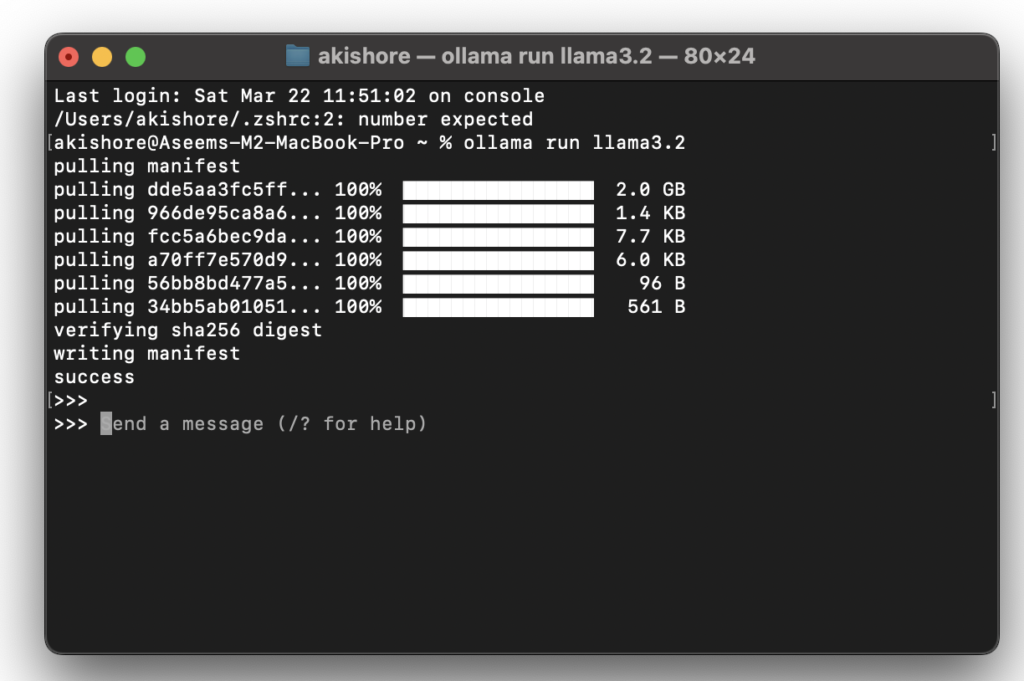

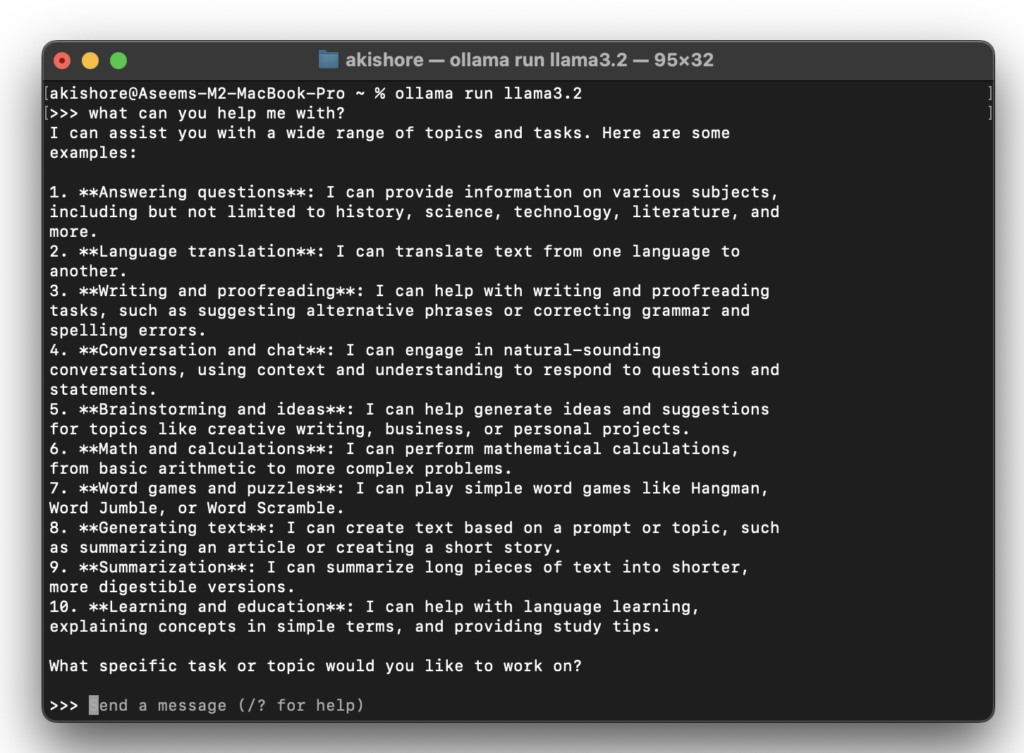

الآن عندما ترى الأسهم الثلاثة ذات الزاوية اليمنى (>>>)، يمكنك البدء في كتابة الأوامر إلى النموذج.

هذا كل شيء! يمكنك الآن التفاعل محليًا مع LLM الخاص بك ولا داعي للقلق بشأن التكاليف أو الإفراط في استخدامه أو أن يتمكن الآخرون من قراءة ما تكتبه. هذا رائع إذا كان لديك بعض الموضوعات الحساسة أو الشخصية التي ترغب في مناقشتها مع AI LLM، ولكنك لا تريد أن تقرأ شركة تقنية كبيرة أفكارك.

استخدام أدوات واجهة المستخدم الرسومية مع Ollama

في حين أن Ollama قوي وفعال للمطورين، قد يفضل بعض المستخدمين واجهة مستخدم رسومية (GUI) للتفاعل مع LLMs. فيما يلي بعض الأدوات التي يمكن أن توفر واجهة أمامية GUI لـ Ollama:

-

-

- Ollama GUI: هذا تطبيق مجاني ومفتوح المصدر لمستخدمي macOS تم إنشاؤه باستخدام SwiftUI. يوفر واجهة جميلة وهو خيار ممتاز لأولئك الذين يرغبون في الوصول إلى نماذج LLM محليًا دون استخدام الجهاز الطرفي.

- Ollama UI: واجهة مستخدم ويب بسيطة تعتمد على HTML تتيح لك تحديد النماذج والتفاعل معها مباشرة في متصفحك. يتضمن أيضًا إضافة Chrome لسهولة الوصول.

- Chatbox AI: هذا هو الأسهل للمبتدئين وهو الذي أشرح كيفية استخدامه أدناه. لاحظ أنك لست بحاجة إلى الحصول على خدمة Chatbox AI، وهو اشتراك يقدمونه حتى تتمكن من الوصول إلى جميع نماذج LLM دون الحاجة إلى تثبيت ollama بنفسك.

-

لاستخدام واجهة Chatbox AI الأفضل، انتقل إلى صفحة التنزيل واحصل على الإصدار الخاص بجهاز Mac الخاص بك.

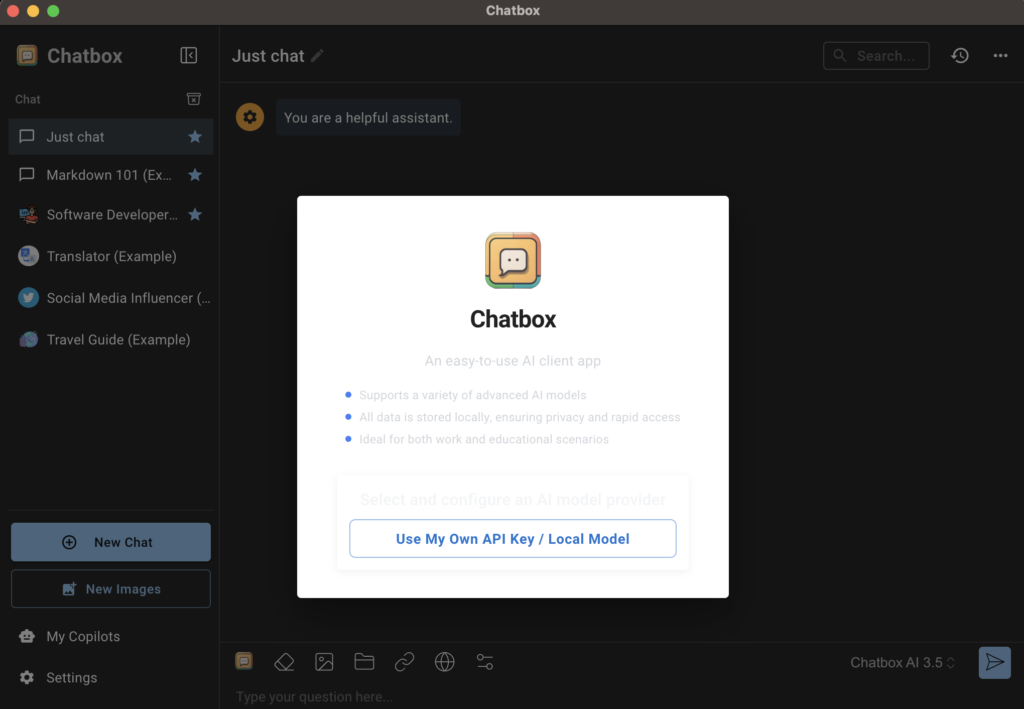

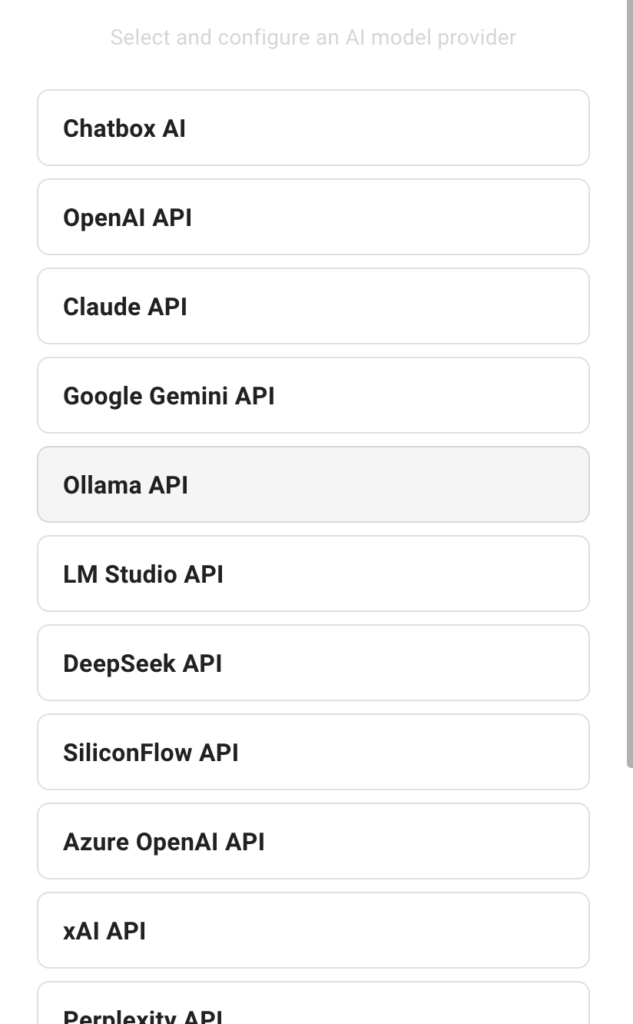

بعد ذلك، افتح المثبت وقم بتشغيل البرنامج. في الشاشة الأولى، ستظهر نافذة منبثقة تسألك عن كيفية استخدام Chatbox AI.

ستحتاج إلى النقر فوق الزر Use My Own API Key / Local Model.

بعد ذلك، انقر على Ollama API كمزود نموذج الذكاء الاصطناعي.

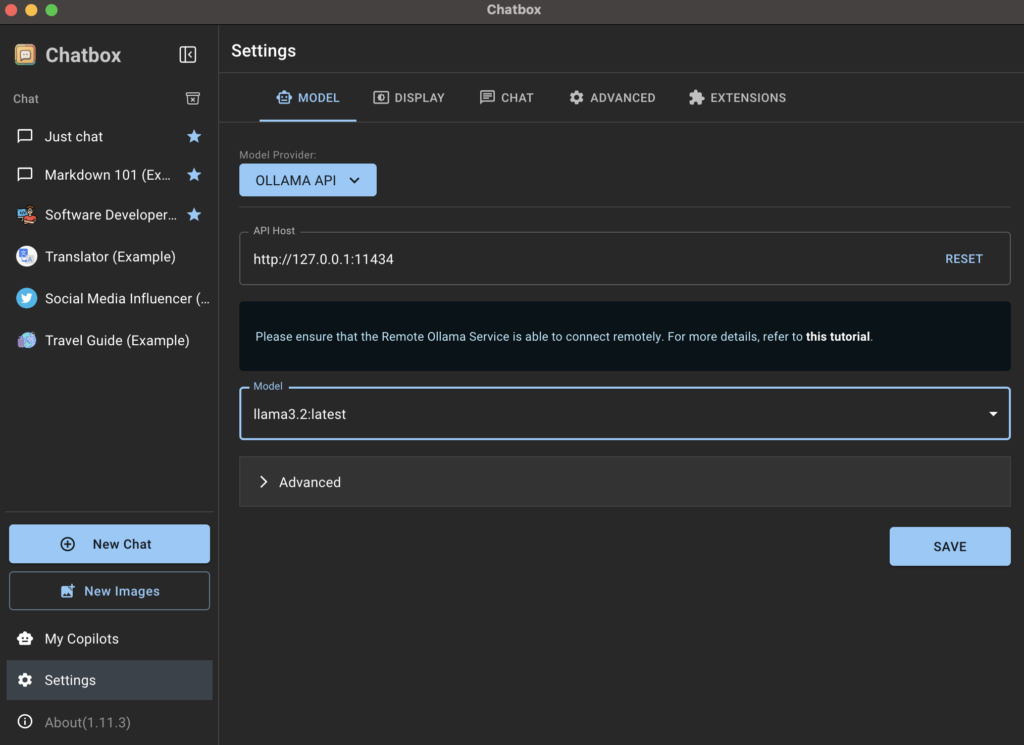

يجب أن يكتشف Chatbox AI تلقائيًا أن Ollama قيد التشغيل ويقوم بتعيين مضيف API إلى القيمة الافتراضية، وهو عنوان IP للإرجاع الحلقي ورقم المنفذ 11434. ليس عليك تغيير أي شيء هنا. ضمن النموذج، يجب أن ترى النماذج التي قمت بتثبيتها سابقًا باستخدام Terminal. في حالتي، هو نموذج llama 3.2.

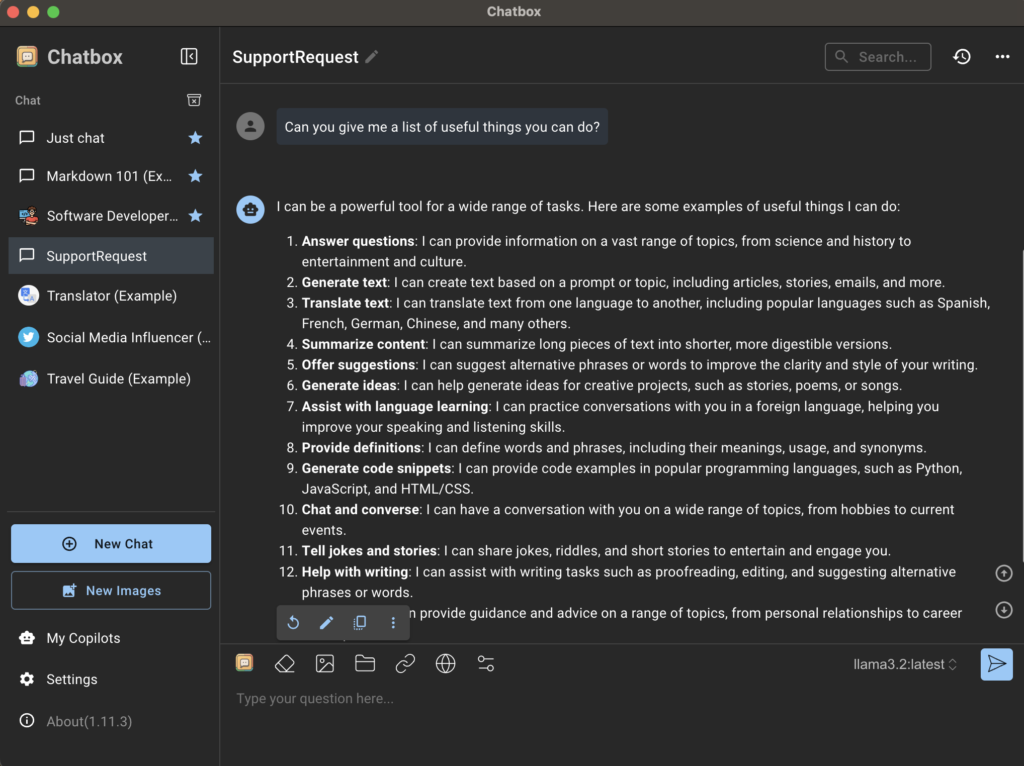

بالعودة إلى الصفحة الرئيسية للتطبيق، انقر على Just chat أو New Chat وتأكد من تحديد النموذج الصحيح في الأسفل على اليمين. يمكنك تغيير النموذج في أي وقت، ولكنني أوصي بإنشاء دردشة جديدة لكل نموذج تستخدمه حتى تتمكن من رؤية الاختلافات بسهولة.

أدوات بديلة لتشغيل نماذج LLM محليًا

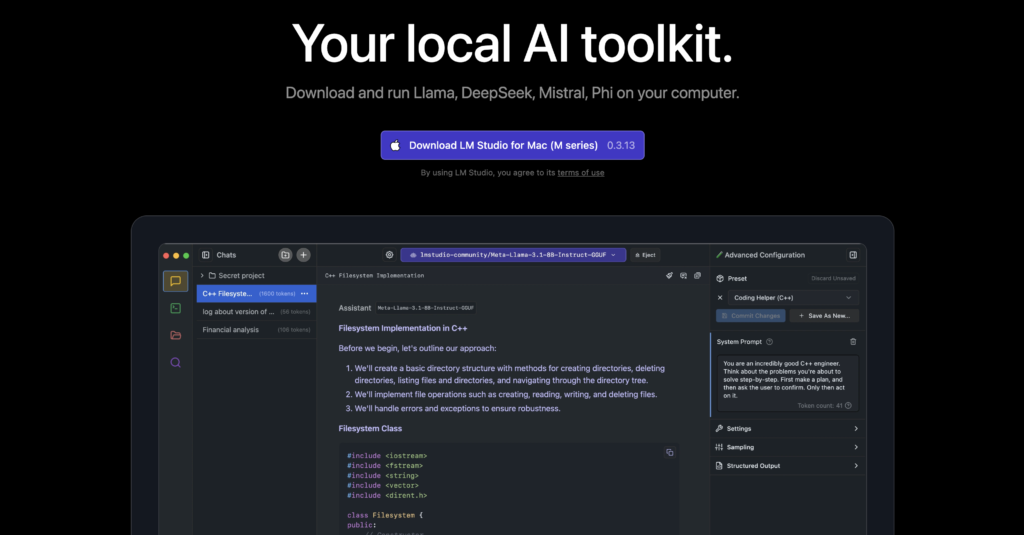

إذا كنت تبحث عن بدائل لـ Ollama أو تفضل تجربة أكثر سهولة في الاستخدام منذ البداية، فإن LM Studio هو خيار ممتاز آخر. يوفر واجهة سهلة الاستخدام لاستكشاف واستخدام نماذج الذكاء الاصطناعي المختلفة، مما يسمح لك بتنزيل وتشغيل النماذج بسهولة. يتوفر LM Studio على أنظمة Linux و Mac و Windows ويوفر ميزات مثل تخصيص معلمات النموذج وسجل الدردشة. إنه مجاني في الوقت الحالي، ولهذا السبب أوصي به على خدمة الاشتراك في Chatbox AI.

الخلاصة

سيكون تشغيل نماذج اللغة الكبيرة محليًا على جهاز Mac الخاص بك مهمًا لأي شخص يتطلع إلى الحصول على مزيد من التحكم في تطبيقات الذكاء الاصطناعي الخاصة به وإعطاء الأولوية لخصوصية البيانات. مع أدوات مثل Ollama والواجهات الأمامية الرسومية المذكورة التي تسهل دمج LLMs في سير عملك، يمكنك بشكل آمن إطلاق إمكانات جديدة للإنتاجية والإبداع.

ومع ذلك، يتطلب البدء في نشر LLM محلي بعض الفهم للمعلمات وكيفية تأثيرها على أداء هذه النماذج على جهازك المحدد. أفضل طريقة لمعرفة ذلك هي اللعب بالنماذج المختلفة لمعرفة أي منها يمنحك أفضل النتائج. بمجرد أن تفهم هذا المفهوم، ستكون قادرًا على اتخاذ قرارات أفضل بشأن النماذج التي ستستخدمها وكيفية تحسين أدائها لتلبية احتياجاتك الخاصة.

Comments are closed.