كيفية استخدام Anthropic Claude AI في Microsoft Copilot

تتطور تقنيات الذكاء الاصطناعي بسرعة، وتقدم Microsoft الآن Claude من Anthropic كنموذج اختياري داخل Microsoft 365 Copilot. بالنسبة لمستخدمي الأعمال، يعني Claude أنه يمكنك اختياره لمهام معينة متعلقة بـ Copilot بإذن من المسؤول.

وبالتالي، يمكنك الاستفادة من نقاط قوة Claude، مثل الاستدلال المطول والاستجابات التي تركز على السلامة. فيما يلي دليل إرشادي يرشدك خلال تمكين Claude وإدارته واستخدامه داخل Copilot.

نظرة عامة سريعة

استخدم Claude كنموذج لغوي كبير (LLM) قابل للاختيار داخل Microsoft 365 Copilot و Copilot Studio لمهام الوكيل والباحث.

- قد يتم استضافة نماذج Anthropic خارج البيئات التي تديرها Microsoft ولها شروطها الخاصة ومعالجة البيانات الخاصة بها. وبالتالي، يلزم موافقة المسؤول والوعي بذلك.

قبل البدء – قائمة التحقق الأساسية للمسؤول

- الوصول إلى مسؤول Microsoft 365. يمكن للمسؤولين فقط السماح لموفري نماذج لغوية كبيرة (LLM) من جهات خارجية للمؤسسة.

- الموافقة القانونية والامتثال. قد تعالج نماذج Anthropic البيانات خارج سيطرة Microsoft المباشرة. علاوة على ذلك، تحقق من معالجة البيانات والاحتفاظ بها والآثار التنظيمية مع فرق الأمان أو الامتثال.

- الترخيص والوعي بالتكلفة. تحقق من ترخيص Copilot/Copilot Studio الخاص بمؤسستك وأي تكاليف أو حصص إضافية لاستخدام نماذج Anthropic.

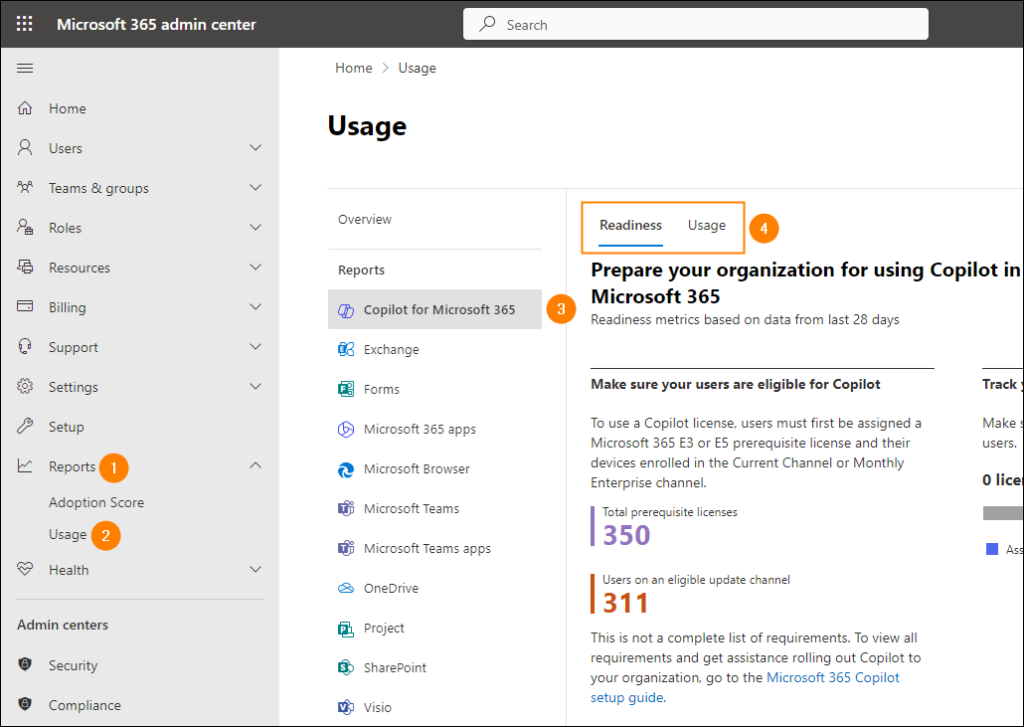

المسؤول: تمكين Anthropic في مركز إدارة Microsoft 365

المصدر Claudecom

- سجّل الدخول إلى Microsoft 365 admin center.

- انتقل إلى Copilot → Settings → Data access (أو منطقة “Connect to AI models”).

- ضمن LLM providers for your organization، حدد موقع Anthropic واسمح للموفر. ستحتاج إلى قبول أي شروط وأحكام معروضة. بعد حفظ الاتصال، قد يستغرق الأمر بضع ساعات حتى يكتمل.

لماذا هذا مهم: التمكين على مستوى المستأجر هو بوابة؛ لن ترى Claude حتى يسمح به المسؤول.

تكوين عناصر التحكم في الحوكمة والبيانات

- نطاق الوصول حسب الوحدة التنظيمية أو المجموعة الأمنية: قم بتقييد الوصول إلى Anthropic لفرق تجريبية (مثل المنتج والبحث) قبل التوزيع الكامل.

- سياسة معالجة البيانات: وثّق أنواع البيانات المسموح بها (لا توجد معلومات صحية محمية/بيانات بطاقات الدفع الحساسة ما لم يكن ذلك مسموحًا به)، وما إذا كان المحتوى الموثق يمكن أن يتدفق إلى بيئة Anthropic. توضح مستندات Microsoft بوضوح أن نماذج Anthropic مستضافة خارجيًا وتسجل ذلك لعمليات التدقيق.

- مراقبة السجلات والقياس عن بعد: تأكد من أن سجلات استخدام Copilot وقواعد DLP (منع فقدان البيانات) نشطة حتى تتمكن من تتبع المحتوى الذي تم إرساله إلى نماذج الطرف الثالث.

كيف يختار مستخدم الأعمال Claude داخل Copilot؟

بمجرد أن تسمح مؤسستك لك وتمكن Anthropic:

- ابحث عن تطبيق Microsoft 365 Copilot أو افتحه أو دردشة Copilot داخل التطبيقات مثل Word و Excel و Outlook.

- في Copilot، حدد Researcher أو اختر Copilot Studio عند إنشاء الوكلاء. سترى خيار Try Claude أو ستتمكن من اختيار نماذج Sonnet/Opus الخاصة بـ Anthropic في Copilot Studio عند تكوين خيارات النموذج. حدد Try Claude أو نموذج Claude المطلوب.

نصيحة: في Researcher، جرب Claude، الذي يوجه مطالبة الوكيل والسياق المطلوب إلى نموذج Anthropic حتى تتمكن من مقارنة المخرجات مقابل نموذج Microsoft الافتراضي.

سير العمل العملي لتجربته أولاً

- تلخيص المستندات والإحاطات الإعلامية: استخدم Claude لملخصات السياق الطويلة، بما في ذلك حزم الاجتماعات والتقارير المطولة.

- البحث والتوريد: قم بإجراء مسح للأدبيات المقارنة أو تجميع ملخصات بحث مشروحة عبر وكيل الباحث (Researcher agent).

- رؤى العملاء: أيضًا، قم بتحليل مجموعات بيانات الملاحظات الكبيرة أو النصوص أو موضوعات البريد الإلكتروني للكشف عن الاتجاهات.

- وكلاء Copilot: في Copilot Studio، قم بإنشاء وكلاء متخصصين في المهام مثل مراجعة المصروفات ومساعد الإعداد. اختر Claude للمهام التي تتطلب تفكيرًا متأنيًا أو مرشحات أمان.

نصائح للمطالبات والتفاعل لمستخدمي الأعمال

- كن صريحًا بشأن السياق: علاوة على ذلك، قم بتضمين المستندات ذات الصلة والنطاقات الزمنية وتنسيق الإخراج المطلوب. قدم ملخصًا تنفيذيًا من 3 نقاط مع عناصر العمل.

- اطلب المصادر: اطلب الاستشهادات أو آثار الأدلة عند استخدام Researcher للعمل الواقعي.

- كرر وقيد: بالنسبة لبعض مهام سير العمل الحساسة، حافظ على نطاق المطالبات ضيقًا وتجنب لصق معلومات التعريف الشخصية (PII) غير المنقحة.

- قارن المخرجات: بالإضافة إلى ذلك، عند التجربة، قم بتشغيل نفس المطالبة مقابل نموذج Microsoft الافتراضي و Claude لمعرفة أي منهما يعمل بشكل أفضل لمهمتك.

الاختبار والقياس والتوسع

- قم بتشغيل تجربة صغيرة (2-4 فرق) لمدة أسبوعين إلى ستة أسابيع واجمع ملاحظات نوعية وكمية.

- تتبع المقاييس مثل الدقة، ومعدل الهلوسة، والوقت الذي تم توفيره، ودرجة ثقة المستخدم، وعدد حوادث منع فقدان البيانات (DLP).

- استخدم النتائج لتوسيع الوصول وإنشاء قوالب وبناء مطالبات داخلية للمهام المتكررة.

تذكيرات الأمان والامتثال

- قد تعالج نماذج Anthropic محتوى مؤسستك في بيئات تستضيفها Anthropic. علاوة على ذلك، ضمان موافقة الفرق القانونية وفرق الخصوصية على هذا النقل.

- إذا لزم الأمر، يمكن للمسؤولين حظر Anthropic لاحقًا عبر نفس إعدادات الوصول إلى البيانات في مركز إدارة المستأجر.

ختامًا: لماذا تجرب Claude في Copilot؟

بالإضافة إلى ذلك، يقدم Anthropic’s Claude خيار نموذج بديل داخل نظام Microsoft’s Copilot البيئي، مما يتيح لشركاتك مطابقة نقاط قوة النموذج بالمهام.

وبالتالي، مع الإدارة السليمة والتجربة المقاسة وإرشادات المستخدم الواضحة، يمكن أن يصبح Claude إضافة قوية إلى مجموعة أدوات Copilot الخاصة بك.

للحصول على إعداد المسؤول وتعليمات خطوة بخطوة رسمية، يمكنك التحقق من مستندات مسؤول Copilot من Microsoft ومنشورات إعلانات Anthropic.

Comments are closed.